La inteligencia artificial está cambiando a gran velocidad la forma en que tomamos decisiones personales y profesionales, el modo en que gestionamos los servicios que prestan nuestras empresas y los criterios con los que procesamos la información en nuestro día a día. En la actualidad, ya convivimos con sistemas capaces de ayudar a priorizar listas de espera o analizar pruebas diagnósticas en el ámbito sanitario, detectar riesgo de abandono escolar o personalizar itinerarios de aprendizaje en educación y evaluar operaciones sospechosas en banca, además de resumir expedientes, clasificar documentos, recomendar actuaciones y generar borradores o incluso interactuar con nosotros en lenguaje natural en un servicio de atención al cliente. En muchos casos, sin que realmente seamos conscientes de ello, ya que estos procesos residen en el interior de las compañías y administraciones públicas con las que tenemos interacciones.

Quizá por ello, a medida que los sistemas de IA adquieren mayor autonomía y pasamos de modelos de lenguaje que responden a nuestras preguntas hacia agentes autónomos capaces de resolver nuestras tareas de forma completa, surgen dudas y preguntas acerca del papel que deben desempeñar los humanos en estos nuevos procesos y sistemas; y más importante aún, sobre la responsabilidad de las decisiones que se toman.

Ese salto ha hecho que la conversación ya no gire solo en torno a si es conveniente usar IA en un determinado proceso, sino sobre cómo se reparte la responsabilidad entre las “máquinas” y las personas. No es casual que el primer principio de la Guía Ética para una IA confiable de la Comisión Europea sea el de autonomía y supervisión humana (human agency and oversight). Esto es, que la IA debe estar al servicio de las personas reforzando su capacidad de decisión y por supuesto siempre contando con mecanismos efectivos de supervisión.

Entre la seguridad del control total y la eficiencia de la autonomía

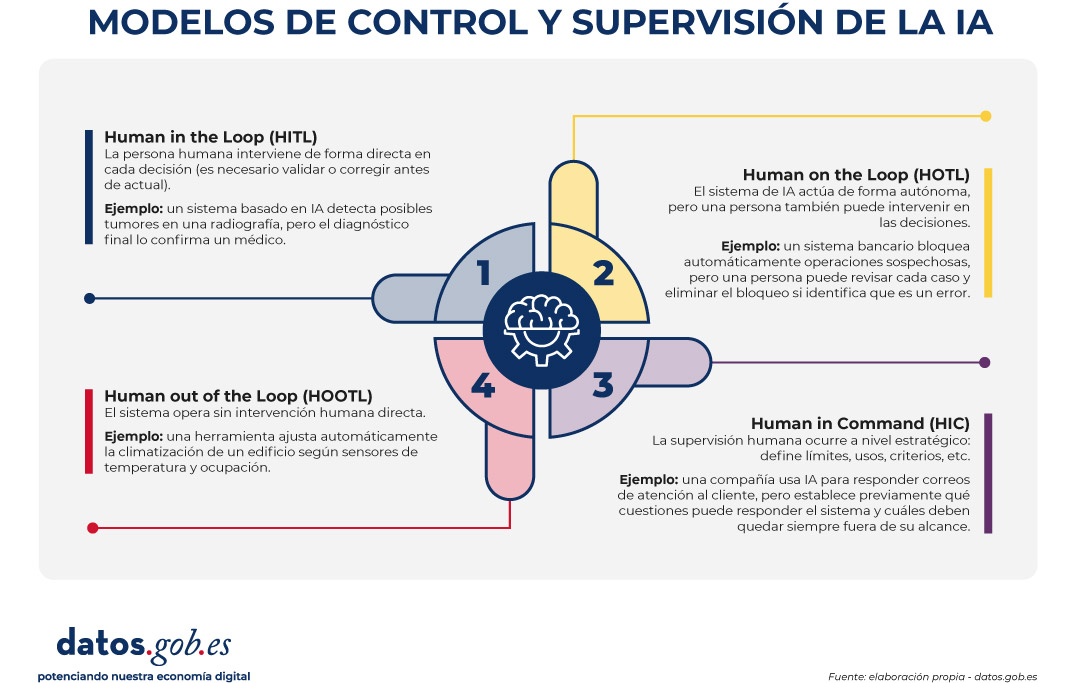

En este contexto cobran sentido enfoques como human-in-the-loop (HITL), human-on-the-loop (HOTL) y human-in-command (HIC), que describen distintas maneras de articular esa intervención humana según el contexto y el nivel de riesgo de cada sistema. No son por tanto etiquetas equivalentes, sino que describen las distintas maneras en que las personas pueden intervenir en la supervisión y la toma de decisiones asociadas a los sistemas de inteligencia artificial.

- En el caso de Human in the Loop (HITL), el ser humano interviene directamente en el ciclo de decisión del sistema. Es decir, la inteligencia artificial sugiere, pero es un agente humano quien valida o corrige antes de que la acción se ejecute. Podría ser el caso, por ejemplo, de un sistema que analizase solicitudes de prestaciones sociales. Diseñaríamos un proceso en el que la IA extraería datos de documentos, los cruzaría con información de otros sistemas para validarlos y prepararía un borrador de resolución. Sin embargo, en la parte final del proceso sería un empleado quien decidiría y firmaría después de validar la propuesta realizada por el sistema automatizado. Sería, por tanto, el modelo más conservador y, también, el más utilizado cuando las decisiones pueden tener consecuencias significativas sobre las personas o sus derechos.

- En el modelo Human on the Loop (HOTL), el sistema puede actuar de forma autónoma, pero un agente humano monitoriza el proceso en tiempo real y tiene la capacidad de intervenir si detecta un problema. A diferencia del enfoque HITL, una persona no participa necesariamente en cada decisión individual, sino que mantiene una función de vigilancia sobre el conjunto de la operación. Es el modelo que se utiliza, por ejemplo, en sistemas de detección de fraude o en el filtrado automatizado de contenidos, donde la IA analiza grandes volúmenes de información y genera alertas o ejecuta acciones preliminares de forma continua. Se trata de encontrar un equilibrio entre eficiencia y control, y es especialmente adecuado para entornos de alto volumen de operaciones donde la intervención humana en cada caso individual no sería viable.

- En el enfoque Human in Command (HIC), la intervención humana no se sitúa necesariamente en cada decisión individual ni en la supervisión continua del sistema, sino en un plano superior de dirección o gobernanza. Son las personas quienes definen para qué puede utilizarse la IA y definen límites, criterios de calidad, el nivel de riesgo aceptable y en qué circunstancias debe revisarse su funcionamiento. Sería el caso, por ejemplo, de una administración que utilizase IA para priorizar inspecciones o para clasificar incidencias: el sistema podría operar con bastante autonomía, pero serían los responsables quienes determinarían su propósito y validarían sus reglas de funcionamiento. Además, auditarían los resultados obtenidos y gestionarían las incidencias producidas, e incluso podrían llegar a suspender el sistema en caso de detectar efectos no deseados. Más que intervenir caso por caso, aquí la función humana consiste en asegurar que la IA permanezca alineada con los objetivos del servicio y el marco normativo.

Frente a estos modelos de gobernanza de la supervisión de los sistemas de IA, también suele mencionarse el enfoque Human out of the Loop (HOOTL), que es aquel en el que el sistema funciona sin intervención humana directa. Se trata del grado más alto de automatización y, por tanto, del escenario que mayores precauciones exige, ya que el margen de corrección humana durante la ejecución es muy reducido o incluso inexistente, como ocurre en algunos sistemas de gestión inteligente de infraestructuras. Por ejemplo, un sistema de IA puede regular automáticamente la climatización de edificios a partir de sensores de temperatura, ocupación, consumo energético, etc, sin que una persona tenga que validar cada decisión. Este modelo puede resultar razonable en tareas muy acotadas y con bajo riesgo de error, como pueden ser procesos de automatización sin efectos relevantes sobre derechos o intereses de las personas. Sin embargo, su aplicación resulta mucho más problemática cuando la IA influye en decisiones sensibles. Por eso, más que como una opción generalizable, el modelo HOOTL debe entenderse como una posibilidad limitada a contextos muy específicos en los que además existan salvaguardas robustas.

El siguiente visual resume estos cuatro tipos de enfoques:

Figura 1. cuatro enfoques de intervención humana en la IA. Fuente: elaboración propia - datos.gob.es.

Por qué importa la elección del enfoque de supervisión humana

La paradoja central de la supervisión humana en los sistemas de IA es que, a medida que estos sistemas mejoran, en parte gracias a esta supervisión, la presión para reducir la intervención humana aumenta. Si un modelo tiene una precisión del 99%, ¿tiene sentido supervisar el sistema o es mejor aceptar los errores? Esta pregunta es legítima desde el punto de vista de la eficiencia, pero encierra sin embargo un riesgo que los especialistas en IA responsable han denominado el problema del "sesgo de automatización". Este sesgo es la tendencia humana a confiar en exceso en sistemas que, en general, funcionan bien, pero que pueden esconder errores difíciles de detectar o, en el peor de los casos, manipulaciones interesadas. Por otra parte, un 1% puede parecer mínimo, pero el porcentaje podría esconder un número muy elevado de errores o pocos errores con un coste inaceptable.

Por ello, la elección entre los diferentes modelos de supervisión no es únicamente técnica, ni está basada en la búsqueda de la eficiencia, ya que tiene implicaciones éticas y legales, y no solo operativas. En particular, el Reglamento Europeo de Inteligencia Artificial (AI Act) dedica su artículo 14 a los requisitos de supervisión humana para los sistemas de IA de alto riesgo, estableciendo que estos deben diseñarse de manera que puedan ser "vigilados de manera efectiva por personas físicas durante el período que estén en uso". Esto convierte el despliegue de un modelo de supervisión en una obligación normativa para numerosas aplicaciones.

La Guía española de supervisión humana, elaborada en el marco del sandbox regulatorio de IA, lo explica detalladamente, desarrollando las cinco grandes exigencias del artículo 14 del Reglamento de IA: vigilancia efectiva durante el uso, mecanismos para minimizar riesgos, fijación de responsabilidades, transparencia y trazabilidad, y garantías adicionales en ciertos sistemas. La Guía también subraya que “la responsabilidad final de las acciones realizadas por un sistema de IA es competencia de las personas de la entidad proveedora y usuaria responsables del mismo” por lo que para que la “vigilancia sea efectiva, las personas deben tener el control sobre el sistema y poder gestionar los riesgos que pueden derivarse de su uso”. Dicho de otro modo, poner a una persona “en el circuito” no basta por sí solo, ya que, si esa persona no comprende el sistema o no tiene autoridad para intervenir, la supervisión será meramente formal, pero no efectiva.

La supervisión humana en el entrenamiento de los sistemas de IA

Hay otra dimensión de la supervisión humana que tiene relevancia en los sistemas de inteligencia artificial y es el papel de esta supervisión en los procesos de entrenamiento de dichos sistemas. Y es que, antes de que un sistema entre en producción, los humanos ya han intervenido en múltiples decisiones que condicionan su comportamiento posterior:

- Por una parte, tenemos la intervención humana en el ciclo de vida de los datos de entrenamiento. La anotación humana integra la inteligencia humana directamente en el ciclo de desarrollo de la IA. Las personas deciden qué datos se recogen, cuáles se descartan, cómo se estructuran y qué variables se consideran relevantes. También intervienen en tareas de depuración, anonimización, control de calidad o revisión de sesgos de los conjuntos de datos. Todo ello tiene una gran influencia porque un modelo no aprende sin más de grandes volúmenes de información, sino de la forma concreta en que esos conjuntos de datos han sido preparados.

- Y, por otra parte, tenemos la intervención humana en la validación del comportamiento los modelos de IA con técnicas como el aprendizaje por refuerzo con retroalimentación humana (RLHF). En esta técnica, anotadores humanos evalúan pares de respuestas generadas por el modelo, indicando cuál es mejor. Con esas evaluaciones se entrena un modelo de recompensa, que, a su vez, guía el ajuste fino del modelo principal. Se trata, en esencia, de una supervisión Human in the Loop en el proceso de entrenamiento: los humanos no solo validan los resultados finales, sino que moldean activamente los valores del sistema. Por tanto, la diversidad de los anotadores, en términos culturales o sociales, tiene impacto directo en el comportamiento del modelo resultante.

En ambos procesos la intervención humana es esencial tanto para garantizar la calidad de los datos de entrenamiento como para asegurar el alineamiento de los modelos con los valores que se desean.

Casos de uso en el sector público

Uno de los primeros casos documentados en el sector público es el de la oficina estadística de Australia (ABS), presentado ya en 2020 en el artículo Human-in-the-Loop AI in Government: A Case Study. El trabajo explica cómo una agencia pública puede aplicar un enfoque Human in the Loop para automatizar parte de la producción de estadísticas oficiales, utilizando como ejemplo la Encuesta de presupuestos familiares. El objetivo no era eliminar la intervención humana, sino ahorrar tiempo y recursos en tareas intensivas en trabajo manual, de manera que los profesionales pudieran concentrarse en actividades de mayor valor añadido. Precisamente ahí reside el interés del caso, ya que demuestra que la IA puede incorporarse a procesos muy exigentes en calidad gracias a la validación humana.

Más reciente es la iniciativa impulsada por el London Office of Technology and Innovation (LOTI), que en marzo de 2025 lanzó un proyecto de investigación específicamente orientado a analizar cuál debe ser el papel de los funcionarios como supervisores de sistemas de IA en los servicios públicos locales. El punto de partida es la constatación de que muchos ayuntamientos ya designan a una persona para revisar o aprobar las salidas de los sistemas automatizados. Sin embargo, esto no significa que exista una supervisión verdaderamente efectiva y, por ello, se busca generar recomendaciones prácticas para que ayuntamientos y otras organizaciones públicas puedan diseñar adecuadamente estos roles de supervisión. El valor de esta iniciativa está en que desplaza el debate: desde la necesidad de que exista la presencia de un humano hacia la definición de las condiciones que hacen esa intervención realmente efectiva.

En definitiva, hablar de Human in the Loop, Human on the Loop o Human in Command es abordar uno de los elementos centrales de la adopción responsable de la inteligencia artificial. Por eso, más que plantear una discusión entre automatización y control humano, el verdadero reto consiste en encontrar el equilibrio adecuado entre ambos. La IA puede aportar eficiencia, pero solo genera verdadero valor si se integra en procesos con mecanismos efectivos de supervisión. En ese sentido, el futuro no parece apuntar aún a sistemas sin personas, sino más bien a organizaciones capaces de combinar de forma excelente el potencial de la IA con el juicio y la responsabilidad que de momento solo pueden aportar los humanos.

Contenido elaborado por Jose Luis Marín, Senior Consultant in Data, Strategy, Innovation & Digitalization. Los contenidos y los puntos de vista reflejados en esta publicación son responsabilidad exclusiva de su autor.