138 documentos encontrados

Guía técnica: Implementación de SHACL

La adopción del nuevo perfil DCAT-AP-ES alinea a España con el perfil de aplicación en Europa (DCAT-AP), facilitando la federación automática entre catálogos de datos definidos en RDF (Resource Description Framework).

En este entorno de grafos RDF donde la flexibilidad es la norma, la ausencia de...

- Guías

Nuevas tendencias y desafíos en el mundo de los datos

El ecosistema digital en torno a los datos ha evolucionado de forma acelerada en los últimos años. Si anteriormente el debate se centraba en el volumen y la velocidad, hoy en día nos encontramos ante un escenario más complejo, donde la inteligencia artificial...

- Guías

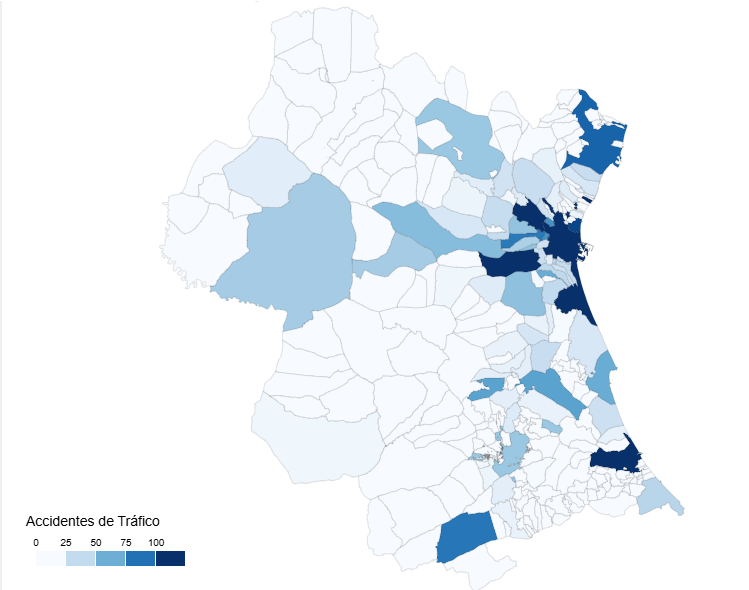

Diseña y visualiza con D3.js datos de siniestralidad en carretera

Introducción

Cada año se producen en España decenas de miles de accidentes, en los que miles de personas resultan heridas de diversa consideración, y que ocurren en circunstancias muy diversas, tanto de tipo de vía, como por el tipo de accidente.

Muchas de las estadísticas relacionadas con estos...

- Ejercicios de datos

Decálogo del reutilizador de datos del sector público

El "Decálogo del reutilizador de datos del sector público" (edición 2025) ofrece una guía actualizada para facilitar el acceso, la reutilización y la puesta en valor de la información del sector público en el contexto presente marcado por la economía del dato, la inteligencia artificial y los...

- Guías

Agente Conversacional con MCP Server para datos.gob.es

Los agentes de IA (como los de Google ADK, LangChain, etc.) son "cerebros". Pero un cerebro sin "manos" no puede actuar en el mundo real (consultar APIs, buscar en bases de datos, etc.). Esas "manos" son las herramientas.

El desafío es: ¿cómo conectas el cerebro con las manos de forma estándar,...

- Ejercicios de datos

Guía técnica: Control de versiones de datos

Los datos poseen una naturaleza fluida y compleja: cambian, crecen y evolucionan constantemente, mostrando una volatilidad que los diferencia profundamente del código fuente. Para responder al desafío de gestionar esta evolución de manera fiable, hemos elaborado la nueva "Guía técnica: Control de...

- Guías

Modelando el presupuesto de subvenciones con Apache Spark: un ejercicio práctico con datos abiertos

En el ecosistema del sector público, las subvenciones representan uno de los mecanismos más importantes para impulsar proyectos, empresas y actividades de interés general. Sin embargo, entender cómo se distribuyen estos fondos, qué organismos convocan ayudas más voluminosas o cómo varía el...

- Ejercicios de datos

Guía práctica para migrar a DCAT-AP-ES

La futura nueva versión de la Norma Técnica de Interoperabilidad de Recursos de Información del Sector Público (NTI-RISP) incorpora DCAT-AP-ES como modelo de referencia para la descripción de conjuntos y servicios de datos. Esto supone un paso clave hacia una mayor interoperabilidad, calidad y...

- Guías

Decálogo del científico de datos

La ciencia de datos se ha consolidado como un pilar de la toma de decisiones basada en evidencias en sectores públicos y privados. En este contexto, surge la necesidad de una guía práctica y universal que trascienda modas tecnológicas y proporcione principios sólidos y aplicables. La presente guía...

- Guías

Ejercicio práctico de regresión lineal múltiple: predice la calidad del aire en Castilla y León

En el campo de la ciencia de datos, la capacidad de construir modelos predictivos robustos es fundamental. Sin embargo, un modelo no es solo un conjunto de algoritmos, es una herramienta que debe ser comprendida, validada y, en última instancia, útil para la toma de decisiones.

Gracias a la...

- Ejercicios de datos