La Agencia Española de Protección de Datos (AEPD), a través de su propia sección de Innovación y Tecnología desempeña una labor didáctica esencial al proporcionar un corpus documental que traduce las obligaciones legales del Reglamento General de Protección de Datos (RGPD) a realidades tecnológicas concretas. Su valor reside en su capacidad para ofrecer seguridad jurídica y pautas técnicas en áreas donde la normativa aún está encontrando su encaje práctico, como la inteligencia artificial o la biometría.

Se trata de guías de referencia, artículos y otros materiales didácticos orientados especialmente a pymes y personas emprendedoras. En este post presentamos algunas de las más recientes, ordenadas según sector y materia.

Las nuevas tendencias de la inteligencia artificial y su despliegue seguro

La evolución de la inteligencia artificial hacia sistemas cada vez más autónomos plantea nuevos retos en materia de protección de datos. Por ello, la Agencia Española de Protección de Datos ha desarrollado diversas guías y documentos orientados a facilitar un despliegue seguro y responsable de esta tecnología. En general, la IA es una de las áreas de mayor actividad documental de la AEPD debido a su impacto transversal. Los recursos de la Agencia cubren desde la gestión interna hasta las tecnologías de última generación.

- Guía inteligencia artificial agéntica desde la perspectiva de protección de datos: la denominada IA agéntica es aquella capaz de tomar decisiones y actuar con cierto grado de independencia. A diferencia de los modelos puramente reactivos, una IA agéntica puede llevar a cabo múltiples tareas de forma autónoma y adoptar decisiones intermedias durante procesos complejos. Esta guía analiza los riesgos de la pérdida de control humano y establece criterios para asegurar que la trazabilidad de las decisiones no se pierda en la automatización.

- Política general para el uso de la IA generativa en procesos administrativos de la AEPD: la inteligencia artificial generativa (IAG o GenAI) es un tipo de IA capaz de producir contenido nuevo, como texto, imágenes, audio o código a partir de patrones aprendidos. Este documento establece una política interna para su uso responsable en procesos administrativos.

- Anexo de implementación de la política general IAG de la AEPD: este anexo al documento anterior incluye los casos de uso permitidos, el tipo de sistemas recomendados (externos, internos o ad hoc), el nivel de riesgo asociado a cada aplicación y las obligaciones específicas de revisión, control humano, seguridad y protección de datos.

- Resumen básico de obligaciones y recomendaciones para la gestión de IA generativa: se trata de un esquema sintetizado sobre aspectos de gobernanza, diseño y desarrollo de casos de uso, tratamiento de datos personales e información sensible, transparencia y explicabilidad, y uso responsable de herramientas, entre otros.

- Informe sobre aprendizaje federado: el aprendizaje federado es un enfoque de inteligencia artificial que permite entrenar modelos de forma colaborativa sin centralizar los datos, mejorando la privacidad y alineándose con el RGPD. Esta guía explica en qué consiste, dónde puede haber un tratamiento de datos personales y cuáles son los beneficios y desafío en la protección de datos.

Para complementar esta información, los usuarios también pueden visitar el blog de la AEPD, que sirve como un observatorio de tendencias donde se analizan los riesgos visibles e invisibles de las tecnologías de consumo. Algunas de las temáticas que se trata son:

- Tratamiento de imagen y voz: se han publicado análisis sobre la transcripción de voz con IA y el uso de servicios que convierten fotografías a otros formatos (como animaciones). Estos artículos alertan sobre el tratamiento de datos biométricos y la propiedad de los datos en la nube.

- Alfabetización algorítmica: recursos como "Abordando conceptos erróneos de la IA" buscan elevar el nivel de juicio crítico de los usuarios y responsables frente a la opacidad de los algoritmos.

- Equilibrio de derechos: destaca el análisis sobre la protección del menor en el entorno digital y el diseño de contratos públicos que integren la privacidad desde el diseño.

Cartera europea de identidad digital

La evolución hacia una Europa interconectada exige estándares de identidad robustos y medidas de seguridad accesibles para todos los niveles empresariales.

La construcción de una identidad digital segura, interoperable y confiable es uno de los pilares de la transformación digital en Europa. La futura cartera europea de identidad digital es un proyecto que plantea permitir a la ciudadanía identificarse electrónicamente y compartir atributos personales de forma controlada en múltiples servicios, tanto públicos como privados.

Para analizar sus implicaciones desde el punto de vista de la privacidad, la Agencia Española de Protección de Datos ha publicado una serie de cuatro artículos monográficos a lo largo de 2025. En ellos, la Agencia desglosa la relación entre la nueva cartera de identidad digital y el RGPD.

Estos contenidos abordan cuestiones clave como:

- La minimización de datos y el principio de proporcionalidad en el intercambio de información: explica cómo el Reglamento eIDAS2 impulsa la cartera europea de identidad digital. Este reglamento establece un marco para una identificación electrónica segura, interoperable y centrada en el usuario, alineada con el RGPD para garantizar el control y la protección de los datos personales en toda la UE.

- Los riesgos asociados a la interoperabilidad entre sistemas: profundiza en cómo evitar que el uso de la Cartera Europea de Identidad Digital permita rastrear a los ciudadanos cuando presentan credenciales en distintos servicios públicos o privados, destacando la necesidad de soluciones criptográficas avanzadas.

- La necesidad de garantizar el control del usuario sobre sus credenciales: examina las amenazas de identificación en las carteras de identidad digital bajo eIDAS2, destacando que, sin garantías sólidas como seudonimización y no vinculación, incluso la revelación selectiva de datos puede permitir la identificación y el perfilado indebido de los usuarios.

- Las medidas de seguridad necesarias para evitar usos indebidos o brechas de datos: plantea las amenazas de inexactitud en las carteras de identidad digital bajo eIDAS2, destacando cómo datos desactualizados o mecanismos criptográficos vinculables pueden provocar decisiones erróneas y comprometer la privacidad. Para solucionarlo, subraya la necesidad de soluciones que garanticen tanto la fiabilidad como la negación plausible (que no exista ninguna prueba técnica que permita demostrar que una persona ha realizado una acción concreta con su cartera o credencial digital).

A través de esta serie, se ofrece una visión progresiva que ayuda a comprender tanto el potencial de la identidad digital europea como los desafíos que plantea su implementación desde una perspectiva de protección de datos.

Cifrado de protección de datos personales en las PYMES

Para muchas pequeñas y medianas empresas, garantizar la seguridad de los datos personales sigue siendo un desafío, especialmente por la falta de recursos técnicos o conocimiento especializado. En este contexto, el cifrado se presenta como una herramienta fundamental para proteger la confidencialidad e integridad de la información.

Con el objetivo de acercar este concepto a un público no experto, la Agencia Española de Protección de Datos ha publicado la Guía de cifrado para autónomos y pymes, acompañada de una infografía explicativa.

Estos recursos explican de manera clara y práctica:

- Qué es el cifrado y por qué es importante en la protección de datos.

- Qué tipos de cifrado existen y en qué casos se aplican.

- Cómo implementar medidas de cifrado en situaciones habituales, como el envío de correos electrónicos o el almacenamiento de información.

- Qué herramientas pueden utilizarse sin necesidad de conocimientos avanzados.

Investigación científica y marco legal europeo

Para los perfiles que requieren un análisis más profundo y académico, la Agencia ha impulsado la publicación de artículos científicos en diversos medios internacionales, que conectan la tecnología con la ética y el derecho. Algunos ejemplos son:

- Patrones adictivos: análisis sobre cómo el diseño de interfaces afecta al comportamiento humano.

- Neurotecnología: estudio sobre los riesgos de las interfaces cerebro-computador.

- Gobernanza algorítmica: un análisis integral que alinea el RGPD con el Reglamento europeo de inteligencia artificial (AI Act), la Ley de Servicios Digitales (DSA, Digital Services Act) y la Ley de Ciberresiliencia.

El valor didáctico de estos materiales reside en su capacidad para ofrecer una visión de 360 grados sobre el dato. Desde la investigación académica de vanguardia hasta las infografías de cifrado para una pequeña empresa, la AEPD proporciona los pilares para una innovación que no sacrifique la privacidad.

En conjunto, estos materiales que comparte la Agencia Española de Protección de datos ayudan a incorporar medidas de seguridad eficaces y a cumplir con los requisitos del Reglamento General de Protección de Datos de forma proporcionada y accesible. Todos ellos, y algunos otros, están recopilados y ordenados por temática en su apartado web, disponible aquí.

El 8 de mayo de 2026 tendrá lugar una nueva edición del Encuentro Nacional de Datos Abiertos (ENDA), esta vez en Pamplona organizado por el Gobierno de Navarra. Una cita clave para que quienes trabajan en innovación pública, reutilización de datos y emprendimiento digital intercambien conocimiento, experiencias y buenas prácticas.

Bajo el lema “Aprende y emprende”, la edición de este año pone el foco en el papel de los datos en la educación y en el impulso de nuevos proyectos empresariales, destacando la importancia de la alfabetización en datos y el potencial de los datos abiertos como motor de innovación, aprendizaje y creación de oportunidades laborales.

Un enfoque abierto centrado en experiencias prácticas

La agenda de esta edición se ha diseñado para abordar los principales desafíos y oportunidades que plantea el uso de datos abiertos en este ámbito concreto. A lo largo del día se explorarán cuestiones como la reutilización de datos en el ámbito educativo, las posibilidades que ofrecen a nivel laboral o el papel de las administraciones públicas como impulsoras de este ecosistema de datos.

La sesión comenzará a las 9:00 con la inauguración a cargo de Javier Remírez Apesteguía vicepresidente primero, consejero de Presidencia e Igualdad y portavoz del Gobierno de Navarra. Le seguirá la ponencia central “IA y datos abiertos: nuevas formas de explotar, entender y crear valor” de Mikel Galar Idoiate, catedrático del área de Ciencias de la Computación e Inteligencia Artificial en la Universidad Pública de Navarra.

A continuación, el evento se desarrollará a lo largo de diversas mesas redondas que permitirán profundizar en diversos temas desde una perspectiva práctica, con ejemplos reales y experiencias compartidas por profesionales que trabajan diariamente con datos.

- Mesa 1: Relación entre educación, emprendimiento y empleo

- Mesa 2: El papel de las Administraciones Públicas en la reutilización de los datos

- Mesa 3: Emprendimiento y datos abiertos: visión y futuro

- Mesa 4: El poder de los datos en la educación

- Mesa 5: Evolución de las políticas de Datos Abiertos

Datos.gob.es participará en esta última mesa aportando su experiencia como plataforma de referencia a nivel nacional en materia de apertura y reutilización de la información del sector público. Por su parte, la Dirección General del Dato compartirá su visión en la mesa 2. En ambos casos, se compartirán tendencias y las líneas de trabajo que se están desarrollando para impulsar la cultura del dato en todo el país.

Un nuevo reto a afrontar

Desde su primera edición, el ENDA ha sido un espacio de encuentro para quienes trabajan con datos abiertos desde perspectivas muy diversas. Cada año, el evento ha ido consolidando una comunidad más amplia y madura, capaz de generar proyectos, metodologías y alianzas que trascienden el propio encuentro. En este sentido, en el marco de cada encuentro se dedica un espacio central a la identificación de un reto que deben abordarse para consolidar un ecosistema de datos más sólido, útil y sostenible. Estos desafíos, definidos de manera colaborativa, permiten orientar las políticas públicas y las iniciativas de reutilización hacia un modelo más maduro y orientado al impacto. Los retos tratados en las ediciones anteriores han sido:

- RETO 1. Generar intercambios de datos y facilitar su apertura, donde los participantes llegaron a una serie de conclusiones para favorecer la colaboración interadministrativa.

- RETO 2. Incrementar las capacidades para la apertura de datos, donde se trabajó en un marco de competencias para que los empleados públicos adquirieran los conocimientos y habilidades necesarias para impulsar los datos abiertos.

- RETO 3. Cómo medir el impacto de los datos abiertos, donde se realizó una propuesta metodológica para el desarrollo de un mapeo sistemático de iniciativas que traten de medir el impacto de los datos abiertos.

- RETO 4. Priorización en la apertura de datos públicos, donde se identificaron los conjuntos de datos a publicar por las administraciones públicas (local, autonómica o nacional). Para ello se desarrolló una propuesta metodológica y una herramienta que permite determinar el nivel de madurez organizativa en políticas de apertura de datos.

Tendremos que esperar a la celebración del V ENDA para conocer cuál es el reto de este año.

Inscripción ya abierta

La jornada está abierta tanto a quienes trabajan con datos en su día a día como a quienes quieren descubrir nuevas oportunidades en el ámbito educativo, profesional o emprendedor. Sea cual sea tu caso, para poder asistir es necesario inscribirse a través de la página web del evento. El formulario permanecerá disponible hasta el 30 de abril de 2026.

Tras cuatro ediciones celebradas en distintos territorios, el ENDA continúa creciendo como un encuentro itinerante que impulsa la colaboración entre administraciones, universidades, empresas y organizaciones ciudadanas, consolidando una comunidad diversa y comprometida con la apertura de datos. Una oportunidad para crecer y seguir aprendiendo.

Si quieres más información, en la web oficial se pueden consultar los contenidos, materiales y aprendizajes de las cuatro ediciones previas, que han contribuido a fortalecer el ecosistema estatal de datos abiertos.

Esta biblioteca quiere poner en valor la memoria histórica de Villel de Mesa, impulsando la investigación, la preservación y la divulgación de todo conocimiento relacionado con el pueblo y proporcionando un acceso libre a todas las personas.

Para ello, persigue los siguientes objetivos:

📚 Catalogar, organizar y digitalizar los documentos y recursos culturales relativos a Villel de Mesa.

🖥️ Facilitar el acceso a los recursos documentales mediante una plataforma virtual.

🔎 Fomentar la investigación y el interés sobre la historia y la cultura de Villel de Mesa.

🤝 Establecer colaboraciones con personas e instituciones culturales para ampliar los recursos disponibles.

Además, cuenta con un nutrido repositorio documental que enlaza a recursos de otras bibliotecas, archivos o entidades. Además, posee un modesto fondo documental propio digitalizado y un conjunto de monografías que tratan ampliamente sobre la historia, el patrimonio, el medio natural o el entorno social de Villel de Mesa.

La visualización de datos no es una disciplina reciente. Desde hace siglos, las personas han utilizado gráficos, mapas y esquemas para representar información compleja. Ejemplos clásicos como los mapas estadísticos del siglo XIX o los gráficos utilizados en la prensa muestran que la necesidad de “ver” los datos para entenderlos ha existido siempre.

Durante mucho tiempo, la creación de visualizaciones requería conocimientos especializados y acceso a herramientas profesionales, lo que limitaba su producción a perfiles muy concretos. Sin embargo, la revolución digital y tecnológica ha transformado profundamente este panorama. En la actualidad, cualquier persona con acceso a un ordenador y a datos puede crear visualizaciones. Las herramientas se han democratizado, muchas de ellas son gratuitas o de código abierto, y el trabajo de visualización se ha extendido más allá del diseño para integrarse en ámbitos como la estadística, la ciencia de datos, la investigación académica, la administración pública o la educación.

Hoy en día, la visualización de datos es una competencia transversal que permite a la ciudadanía explorar información pública, a las instituciones comunicar mejor sus políticas y a los reutilizadores generar nuevos servicios y conocimientos a partir de los datos abiertos. En este post presentamos algunas de las opciones más accesibles y utilizadas en visualización de datos.

Un ecosistema amplio y diverso de herramientas

El ecosistema de herramientas de visualización de datos es amplio y diverso, tanto en funcionalidades como en niveles de complejidad. Existen opciones pensadas para una primera exploración de los datos, otras orientadas al análisis en profundidad y algunas diseñadas para crear visualizaciones interactivas o narrativas digitales complejas.

Esta variedad permite adaptar la visualización a distintos contextos y objetivos: desde comprender un conjunto de datos de forma preliminar hasta publicar gráficos interactivos, paneles de control o mapas en la web.

La encuesta anual de la Data Visualization Society refleja esta diversidad y muestra cómo el uso de determinadas herramientas evoluciona con el tiempo, consolidando algunas opciones ampliamente conocidas y dando paso a nuevas soluciones que responden a necesidades emergentes. Estas son algunas de las herramientas que se mencionan en la encuesta, ordenadas según perfiles de uso.

Para la elaboración de este listado se ha tenido en cuenta los siguientes criterios:

- Grado de uso y madurez de la herramienta.

- Acceso libre, gratuito o con versiones abiertas.

- Utilidad para proyectos relacionados con datos públicos.

- Prioridad a herramientas abiertas o con versiones gratuitas.

Herramientas sencillas para empezar

Estas herramientas se caracterizan por contar con interfaces visuales, una curva de aprendizaje baja y la posibilidad de crear gráficos básicos de forma rápida. Son especialmente útiles para comenzar a explorar conjuntos de datos abiertos o para actividades de divulgación.

- Excel: es una de las herramientas más extendidas y conocidas. Permite realizar gráficos básicos y primeras exploraciones de datos de forma sencilla. Aunque no está diseñada específicamente para la visualización avanzada, sigue siendo una puerta de entrada habitual al trabajo con datos y su representación gráfica.

- Google Sheets: funciona como una alternativa gratuita y colaborativa a Excel. Su principal ventaja es la posibilidad de trabajar de forma compartida y publicar gráficos sencillos en línea, lo que facilita la difusión de visualizaciones básicas.

- Datawrapper: muy utilizada en comunicación pública y periodismo de datos. Permite crear gráficos claros, mapas y tablas interactivas sin necesidad de conocimientos técnicos. Es especialmente adecuada para explicar datos de forma comprensible a un público amplio.

- RAWGraphs: herramienta de software libre orientada a la exploración visual. Permite experimentar con tipos de gráficos menos habituales y descubrir nuevas formas de representar datos. Resulta especialmente útil en fases exploratorias.

- Canva: aunque su enfoque es más divulgativo que analítico, puede ser útil para crear piezas visuales sencillas que integren gráficos básicos con elementos de diseño. Es adecuada para la comunicación visual de resultados, no tanto para el análisis de datos.

Herramientas de análisis y exploración de datos

Este grupo de herramientas está orientado a perfiles que desean ir más allá de los gráficos básicos y realizar análisis más estructurados. Muchas de ellas son abiertas y están ampliamente consolidadas en el ámbito del análisis de datos.

- R: lenguaje de programación libre muy utilizado en estadística y análisis de datos. Dispone de un amplio ecosistema de paquetes que permiten trabajar con datos públicos de forma reproducible y transparente.

- Ggplot2: librería de visualización del lenguaje R. Es una de las herramientas más potentes para crear gráficos rigurosos y bien estructurados, tanto para análisis como para comunicación de resultados.

- Python (Matplotlib y Plotly): Python es uno de los lenguajes más utilizados en análisis de datos. Matplotlib permite crear gráficos estáticos personalizables, mientras que Plotly facilita la creación de visualizaciones interactivas. Juntas ofrecen un buen equilibrio entre potencia y flexibilidad.

- Apache Superset: plataforma de código abierto para análisis de datos y creación de paneles de control. Tiene un enfoque más institucional y escalable, lo que la hace adecuada para organizaciones que trabajan con grandes volúmenes de datos públicos.

Este bloque resulta especialmente relevante para reutilizadores de datos abiertos y perfiles técnicos intermedios que buscan combinar análisis y visualización de forma sistemática.

Herramientas para visualización interactiva y web

Estas herramientas permiten crear visualizaciones avanzadas para su publicación en entornos web. Aunque requieren mayores conocimientos técnicos, ofrecen una gran flexibilidad y posibilidades expresivas.

- D3.js: es uno de los referentes en visualización web. Se basa en estándares abiertos y permite un control total sobre la representación visual de los datos. Su flexibilidad es muy alta, aunque también lo es su complejidad.

En este ejercicio práctico puedes ver cómo se utiliza esta librería

- Vega y Vega-Lite: lenguajes declarativos para visualización que simplifican el uso de D3. Permiten definir gráficos de forma estructurada y reproducible, ofreciendo un buen equilibrio entre potencia y simplicidad.

- Observable: entorno interactivo muy ligado a D3 y Vega. Es especialmente útil para crear ejemplos educativos, prototipos y visualizaciones exploratorias que combinan código, texto y gráficos.

- Three.js y WebGL: tecnologías orientadas a visualizaciones avanzadas y en tres dimensiones. Su uso es más experimental y suele estar vinculado a proyectos de divulgación o investigación visual.

En este apartado conviene destacar que, aunque las barreras técnicas son mayores, estas herramientas permiten crear experiencias interactivas ricas que pueden resultar muy eficaces para comunicar datos públicos complejos.

Herramientas de cartografía y datos geoespaciales

La visualización geográfica es especialmente relevante en el ámbito de los datos abiertos, ya que una gran parte de la información pública tiene una dimensión territorial. En este campo, el software libre tiene un peso destacado y está muy alineado con el uso en administraciones públicas.

- QGIS: referente en software libre para sistemas de información geográfica (GIS). Es ampliamente utilizado en administraciones públicas y permite analizar y visualizar datos espaciales con gran detalle.

- ArcGIS: muy extendido en el ámbito institucional. Aunque no es software libre, su uso está muy consolidado y forma parte del ecosistema habitual de muchas organizaciones públicas.

- Mapbox: plataforma orientada a la creación de mapas web interactivos. Es muy utilizada en proyectos de visualización online y permite integrar datos geográficos en aplicaciones web.

- Leaflet: librería de código abierto muy popular para crear mapas interactivos en la web. Es ligera, flexible y ampliamente utilizada en proyectos de reutilización de datos abiertos geográficos.

Este conjunto de herramientas facilita la representación territorial de los datos y su reutilización en contextos locales, regionales o nacionales.

En conclusión, la elección de una herramienta de visualización depende en gran medida del objetivo que se persiga. No es lo mismo aprender y experimentar que analizar datos en profundidad o comunicar resultados a un público amplio. Por ello, resulta útil reflexionar previamente sobre el tipo de datos disponibles, el público al que se dirige la visualización y el mensaje que se quiere transmitir.

Apostar por herramientas accesibles y abiertas permite que más personas puedan explorar, interpretar y comunicar datos públicos. En este sentido, visualizar datos es también una forma de acercar la información a la ciudadanía y fomentar su reutilización.

Las visualizaciones de datos actúan como puentes entre la información compleja y la comprensión humana. Un gráfico bien diseñado puede comunicar en segundos datos que llevaría minutos o incluso horas descifrar en formato tabular. Más aún, las visualizaciones interactivas permiten a cada usuario explorar los datos desde su propia perspectiva, filtrando, comparando y descubriendo insights personalizados.

Para alcanzar estos fines existen múltiples herramientas, algunas de las cuales hemos abordado en ocasiones anteriores. Hoy nos acercamos a un nuevo ejemplo: la librería gratuita D3.js. En este post te explicamos cómo permite generar visualizaciones de datos útiles y atractivas junto con la herramienta de código abierto Observable.

¿Qué es D3?

D3.js (Data-Driven Documents) es una biblioteca de JavaScript que permite crear visualizaciones de datos personalizadas en navegadores web. A diferencia de herramientas que ofrecen gráficos predefinidos, D3.js proporciona los elementos fundamentales para construir prácticamente cualquier tipo de visualización imaginable.

La biblioteca es completamente gratuita y de código abierto, publicada bajo licencia BSD, lo que significa que cualquier persona u organización puede utilizarla, modificarla y distribuirla sin restricciones. Esta característica ha contribuido a su adopción generalizada: medios de comunicación internacionales como The New York Times, The Guardian, Financial Times y locales como El País o el ABC utilizan D3.js para crear visualizaciones periodísticas que ayudan a contar historias con datos.

D3.js funciona manipulando el DOM (Document Object Model) del navegador. En términos prácticos, esto significa que toma información (por ejemplo, un archivo CSV con datos de población) y la transforma en elementos visuales (círculos, barras, líneas) que el navegador puede mostrar. La potencia de D3.js reside en su flexibilidad: no impone una forma específica de visualizar datos, sino que proporciona las herramientas para crear exactamente lo que se necesita.

¿Qué es Observable?

Observable es una plataforma web para crear y compartir código, especialmente diseñada para trabajar con datos y visualizaciones. Aunque ofrece un servicio freemium con algunas funcionalidades gratuitas y otras de pago, mantiene una filosofía de código abierto que resulta particularmente relevante para el trabajo con datos públicos.

La característica distintiva de Observable es su formato de "cuadernos computacionales" (notebooks). Similar a herramientas como Jupyter Notebooks en Python, un cuaderno de Observable combina código, visualizaciones y texto explicativo en un mismo documento interactivo. Cada celda del cuaderno puede contener código JavaScript que se ejecuta inmediatamente, mostrando resultados al instante. Esto crea un entorno de experimentación ideal para explorar datos.

Puedes verlo en la práctica en este ejercicio de ciencia de datos que hemos publicado en datos.gob.es

Observable se integra naturalmente con D3.js y otras bibliotecas de visualización. De hecho, el creador de D3.js, es también uno de los fundadores de Observable, por lo que ambas herramientas trabajan conjuntamente de manera fluida. Los cuadernos de Observable pueden compartirse públicamente, permitiendo que otros usuarios vean tanto el código como los resultados, los bifurquen (fork) para crear sus propias versiones, o los integren en sus propios proyectos.

Ventajas de la herramienta para trabajar con todo tipo de datos

Tanto D3.js como Observable presentan características que pueden resultar útiles para trabajar con datos, entre ellos, con datos abiertos:

- Transparencia y reproducibilidad: al publicar una visualización creada con estas herramientas es posible compartir tanto el resultado final como todo el proceso de transformación de datos. Cualquier persona puede inspeccionar el código, verificar los cálculos y reproducir los resultados. Esta transparencia resulta fundamental cuando se trabaja con información pública, donde la confianza y la verificabilidad son esenciales.

- Sin costes de licencia: tanto D3.js como la versión gratuita de Observable permiten crear y publicar visualizaciones sin necesidad de adquirir licencias de software. Esto elimina barreras económicas para organizaciones, periodistas, investigadores o ciudadanos que desean trabajar con datos abiertos.

- Formatos web estándar: las visualizaciones creadas funcionan directamente en navegadores web sin necesidad de plugins o software adicional. Esto facilita su integración en sitios web institucionales, artículos periodísticos o informes digitales, haciéndolas accesibles desde cualquier dispositivo.

- Comunidad y recursos: existe una amplia comunidad de usuarios que comparten ejemplos, tutoriales y soluciones a problemas comunes. Observable, en particular, alberga miles de cuadernos públicos que sirven como ejemplos y plantillas reutilizables.

- Flexibilidad técnica: a diferencia de herramientas con opciones predefinidas, estas bibliotecas permiten crear visualizaciones completamente personalizadas que se adapten exactamente a las necesidades específicas de cada conjunto de datos o historia que se quiera contar.

Es importante señalar que estas herramientas requieren conocimientos de programación, específicamente de JavaScript. Para personas sin experiencia en programación, existe una curva de aprendizaje que puede resultar pronunciada inicialmente. Otras herramientas como hojas de cálculo o software de visualización con interfaces gráficas pueden ser más apropiadas para usuarios que buscan resultados rápidos sin necesidad de escribir código.

Para quienes buscan alternativas open source con una curva de aprendizaje suave, existen herramientas basadas en interfaz visual que no requieren programar. Por ejemplo, RawGraphs permite crear visualizaciones complejas simplemente arrastrando y soltando archivos, mientras que Datawrapper es una opción excelente y muy intuitiva para generar gráficos y mapas listos para publicar.

Además, existen numerosas alternativas tanto de código abierto como comerciales para visualizar datos: Python con bibliotecas como Matplotlib o Plotly, R con ggplot2, Tableau Public, Power BI, entre muchas otras. En la sección didáctica de ejercicios de visualización y ciencia de datos de datos.gob.es puedes encontrar ejemplos prácticos de uso de algunas de ellas.

En resumen, la elección de herramientas debe basarse siempre en una evaluación de requisitos específicos, recursos disponibles y objetivos del proyecto. Lo importante es que los datos abiertos se transformen en conocimiento accesible, y existen múltiples caminos para lograr este objetivo. D3.js y Observable ofrecen uno de estos caminos, particularmente adecuado para quienes buscan combinar flexibilidad técnica con principios de apertura y transparencia. Si conoces alguna otra herramienta o te gustaría que profundizáramos en otra temática, háznosla llegar a través de nuestras redes sociales o en el formulario de contacto.

La Navidad vuelve cada año como una oportunidad para detenernos, respirar y reconectar con aquello que nos inspira. Desde datos.gob.es, aprovechamos estas fechas para compartir nuestra tradicional carta de recomendaciones: una selección de libros que invitan a comprender mejor el mundo digital, reflexionar sobre el impacto de la inteligencia artificial, mejorar nuestras competencias profesionales y asomarnos a los dilemas éticos que marcan nuestro tiempo.

En este post, recopilamos obras de ética tecnológica, sociedad digital, ingeniería de IA, computación cuántica, aprendizaje automático y gobierno del dato. Una lista variada, con títulos tanto en castellano como en inglés, que combina rigor académico, divulgación y visión crítica. Si buscas una lectura que te haga crecer, sorprender a algún ser querido o simplemente alimentar tu curiosidad, aquí encontrarás opciones para todos los gustos.

La ética de la inteligencia artificial de Sara Degli-Esposti

-

¿De qué va? Esta especialista en privacidad y análisis de datos ofrece una visión clara y rigurosa sobre los riesgos y oportunidades de la IA aplicada a ámbitos como la salud, la seguridad, las políticas públicas o la comunicación digital. Su propuesta destaca por integrar perspectivas jurídicas, sociotécnicas y de derechos fundamentales.

-

¿A quién va dirigido? Lectores que busquen una introducción sólida al debate internacional sobre ética y regulación de la IA.

Disponible gratuitamente aquí: https://ciec.edu.co/wp-content/uploads/2024/12/LA-ETICA-DE-LA-INTELIGENCIA-ARTIFICIAL.pdf

Entiende la tecnología de Nate Gentile

-

¿De qué va? En este libro, el divulgador y especialista en hardware y cultura digital Nate Gentile desmonta mitos, explica conceptos técnicos de forma accesible y ofrece una mirada crítica sobre cómo funciona realmente la tecnología que utilizamos cada día. Desde el rendimiento de los procesadores y las arquitecturas de los sistemas hasta los modelos de negocio de las grandes plataformas, la obra combina rigor técnico con un estilo cercano, acompañado de ejemplos prácticos y anécdotas de la comunidad tecnológica.

-

¿A quién va dirigido? Lectores curiosos que quieran comprender mejor el funcionamiento interno de los dispositivos, profesionales que busquen una aproximación divulgativa pero precisa, y cualquier persona que desee perder el miedo a la tecnología y entenderla de forma más consciente.

Clics contra la humanidad de James Williams

-

¿De qué va? Esta obra periodística analiza cómo las plataformas digitales moldean nuestra atención, nuestras creencias y nuestras decisiones. A través de historias reales, el libro muestra el impacto del diseño algorítmico en la política, la opinión pública y la vida diaria. Una lectura incisiva y oportuna, especialmente en un momento de creciente preocupación por la desinformación y la economía de la atención.

-

¿A quién va dirigido? Quienes quieran entender cómo funcionan las plataformas y qué efectos pueden tener en la sociedad.

La primavera de la inteligencia artificial de Carmen Torrijos y José Carlos Sánchez

- ¿De qué va? A partir de ejemplos cotidianos, los autores explican qué son realmente los modelos de lenguaje, cómo funcionan tecnologías como ChatGPT o la visión por computador, qué transformaciones están generando en sectores como la educación, la creatividad o la comunicación, y cuáles son sus límites actuales. Además, aportan una reflexión crítica sobre los retos éticos, sociales y laborales asociados a esta nueva ola de innovación.

- ¿A quién va dirigido? Lectores que quieran comprender el fenómeno actual de la IA sin necesidad de conocimientos técnicos, docentes y profesionales que buscan contextualizar su impacto en su sector, y cualquier persona interesada en entender qué hay detrás del boom de la IA generativa y cómo puede influir en nuestro futuro inmediato.

Diseño de sistemas de Machine Learning de Chip Huyen

-

¿De qué va? Es un manual práctico y moderno que explica, de principio a fin, cómo diseñar, desplegar y mantener sistemas de machine learning robustos. Chip Huyen combina experiencia técnica con claridad divulgativa, abordando desde ingeniería de datos hasta monitorización de modelos y MLOps. Una obra muy valorada en la industria.

-

¿A quién va dirigido? Profesionales técnicos, equipos que implantan productos basados en IA y estudiantes que quieran entender cómo se construyen sistemas reales en producción.

Ética en la Inteligencia Artificial y las Tecnologías de la Información de Gabriela Arriagada-Bruneau, Claudia López y Marcelo Mendoza

-

¿De qué va? Este libro aborda uno de los grandes desafíos de nuestro tiempo: cómo desarrollar sistemas de IA respetuosos con las personas y con la sociedad. Las autoras analizan principios de equidad, transparencia, responsabilidad y gobernanza, combinando fundamentos filosóficos con ejemplos prácticos. Su enfoque iberoamericano resulta especialmente valioso para comprender cómo estos retos afectan a esta región.

-

¿A quién va dirigido? Estudiantes, responsables públicos, profesionales de la tecnología y cualquier persona que quiera entender los dilemas éticos detrás de los algoritmos que utilizamos a diario.

Generative Deep Learning: Teaching Machines to Paint, Write, Compose, and Play de David Foster

-

¿De qué va? Esta obra, que ya es un clásico en su terreno, introduce las arquitecturas generativas más importantes (GANs, VAEs, modelos de difusión) con ejemplos y código reproducible. La segunda edición actualiza conceptos y aporta nuevos casos prácticos relacionados con texto, sonido e imagen.

-

¿A quién va dirigido? Quienes quieran aprender a crear modelos generativos desde cero o entender las tecnologías que están detrás de la creación automática de contenido.

Supremacía cuántica de Michio Kaku

-

¿De qué va? La computación cuántica ha dejado de ser ciencia ficción para convertirse en un campo estratégico global. Michio Kaku, divulgador reconocido, explica con claridad qué es un qubit, cómo funcionan los ordenadores cuánticos, qué límites presentan y qué transformaciones impulsarán en criptografía, simulación química o inteligencia artificial.

-

¿A quién va dirigido? Ideal para amantes de la ciencia, curiosos tecnológicos y lectores que quieran asomarse al futuro de la computación sin necesidad de conocimientos matemáticos avanzados.

Gobierno del Dato basado en especificaciones UNE de Ismael Caballero, Fernando Gualo y Mario G. Piattini

-

¿De qué va? Este libro es una guía completa para entender y aplicar las normas UNE relativas al gobierno del dato en las organizaciones. Explica de forma clara cómo estructurar roles, procesos, políticas y controles para gestionar los datos como un activo estratégico. Incluye casos prácticos, modelos de madurez, ejemplos de implantación y orientaciones para alinear la gobernanza con estándares internacionales y con las necesidades reales del sector público y privado. Un recurso especialmente útil en un momento en el que la calidad, la trazabilidad y la interoperabilidad de los datos son fundamentales para impulsar la transformación digital.

-

¿A quién va dirigido? Responsables de datos (CDO), equipos de analítica y arquitectura, profesionales de administraciones públicas, consultores y cualquier organización que quiera implantar un modelo formal de gobierno del dato basado en estándares reconocidos.

Aunque nos encantaría incluir muchos más títulos, esta selección ya es un excelente punto de partida para explorar los grandes temas que configurarán la transformación digital de los próximos años. Si en estas fiestas te apetece regalar conocimiento, estas obras serán un acierto seguro: combinan actualidad, reflexión crítica, aplicaciones prácticas y una mirada amplia al futuro tecnológico.

Recuerda que, aunque aquí mencionamos títulos que puedes encontrar en librerías online, siempre te animamos a consultar primero en tu librería de barrio. Es una forma magnífica de apoyar al pequeño comercio y contribuir a que el ecosistema cultural siga vivo y vibrante.

¿Nos recomiendas otro título?

En datos.gob.es nos encanta descubrir nuevas lecturas. Si conoces algún libro sobre datos, IA, tecnología o sociedad digital que merezca estar en próximas ediciones, puedes compartirlo en los comentarios o escribirnos a través de este formulario. ¡Felices fiestas y felices lecturas!

La visualización de datos es una práctica fundamental para democratizar el acceso a la información pública. Sin embargo, crear gráficos efectivos va mucho más allá de elegir colores atractivos o utilizar las últimas herramientas tecnológicas. Como señala Alberto Cairo, experto en visualización de datos y docente de la academia del portal europeo de datos abiertos (data.europa.eu), “cada decisión de diseño debe ser deliberada: inevitablemente subjetiva, pero nunca arbitraria”. A través de una serie de tres webinar que puedes volver a ver aquí, el experto ofreció consejos innovadores para estar a la vanguardia de la visualización de datos.

Cuando trabajamos con visualización de datos, especialmente en el contexto de la información pública, es crucial desmontar algunos mitos arraigados en nuestra cultura profesional. Frases como "los datos hablan por sí mismos", "una imagen vale más que mil palabras" o "muestra, no cuentes" suenan bien, pero esconden una verdad incómoda: los gráficos no siempre comunican automáticamente.

La realidad es más compleja. Un/a profesional del diseño puede querer comunicar algo específico, pero los lectores pueden interpretar algo completamente diferente. ¿Cómo se puede superar la brecha entre intención y percepción en visualización de datos? En este post, ofrecemos algunas claves de la serie formativa.

Un marco estructurado para diseñar con propósito

En lugar de seguir "reglas" rígidas o aplicar plantillas predefinidas, en el curso se propone un marco de pensamiento basado en cinco componentes interrelacionados:

- Contenido: la naturaleza, origen y limitaciones de los datos

- Personas: la audiencia a la que nos dirigimos

- Intención: los propósitos que definimos

- Restricciones: las limitaciones que enfrentamos

- Resultados: cómo es recibido el gráfico

Este enfoque holístico nos obliga a preguntarnos constantemente: ¿qué necesitan realmente saber nuestros lectores? Por ejemplo, cuando comunicamos información sobre riesgos de huracanes o emergencias sanitarias, ¿es más importante mostrar trayectorias exactas o comunicar impactos potenciales? La respuesta correcta depende del contexto y, sobre todo, de las necesidades informativas de la ciudadanía.

El peligro de la agregación excesiva

Aún sin perder de vista el propósito es importante no caer en añadir demasiada información o presentar solo promedios. Imaginemos, por ejemplo, un conjunto de datos sobre seguridad ciudadana a nivel nacional: un promedio puede esconder que la mayoría de las localidades son muy seguras, mientras unas pocas con tasas extremadamente altas distorsionan el indicador nacional.

Como explica Claus O. Wilke en su libro "Fundamentals of Data Visualization", esta práctica puede ocultar patrones cruciales, valores atípicos y paradojas que son precisamente los más relevantes para la toma de decisiones. Para evitar este riesgo, en la formación se propone visualizar una gráfica como un sistema de capas que debemos construir cuidadosamente desde la base:

1. Codificación (Encoding)

- Es la base de todo: cómo traducimos datos en atributos visuales. Las investigaciones en percepción visual nos muestran que no todos los "canales visuales" son igual de efectivos. La jerarquía sería:

- Más efectivos: posición, longitud y altura

- Medianamente efectivos: ángulo, área y pendiente

- Menos efectivos: color, saturación y forma

¿Cómo ponemos esto en práctica? Pues, por ejemplo, para realizar comparaciones precisas, un gráfico de barras será casi siempre mejor opción que un gráfico circular. Sin embargo, como se matiza en los materiales formativos, "efectivo" no siempre significa "apropiado". Un gráfico circular puede ser perfecto cuando queremos expresar la idea de un "todo y sus partes", aunque las comparaciones precisas sean más difíciles.

2. Disposición (Arrangement)

El posicionamiento, orden y agrupación de los elementos afecta profundamente a la percepción. ¿Queremos que el lector compare entre categorías dentro de un grupo, o entre grupos? La respuesta determinará si organizamos nuestra visualización con barras agrupadas o apiladas, con paneles múltiples o en una única vista integrada.

3. Andamiaje (Scaffolding)

Los títulos, introducciones, anotaciones, escalas y leyendas son fundamentales. En datos.gob.es hemos visto cómo las visualizaciones interactivas pueden condensar información compleja, pero sin un andamiaje adecuado, la interactividad puede confundir más que aclarar.

El valor de una correcta escala

Uno de los aspectos técnicos más delicados —y a menudo más manipulables— de una visualización es la elección de la escala. Una simple modificación en el eje Y puede cambiar por completo la interpretación del lector: una tendencia suave puede parecer una crisis repentina, o un crecimiento sostenido puede pasar desapercibido.

Como se menciona en el segundo webinar de la serie, las escalas no son un detalle menor: son un componente narrativo. Decidir dónde empieza un eje, qué intervalos se usan o cómo se representan los periodos de tiempo implica hacer elecciones que afectan directamente la percepción de la realidad. Por ejemplo, si una gráfica de empleo comienza el eje Y en 90 % en lugar de 0 %, el descenso puede parecer dramático, aunque, en realidad, sea mínimo.

Por eso, las escalas deben ser honestas con los datos. Ser “honesto” no significa renunciar a decisiones de diseño, sino mostrar claramente qué decisiones se tomaron y por qué. Si existe una razón válida para empezar el eje Y en un valor distinto de cero, debe explicarse explícitamente en la gráfica o en su pie de texto. La transparencia debe prevalecer sobre el dramatismo.

La integridad visual no solo protege al lector de interpretaciones engañosas, sino que refuerza la credibilidad de quien comunica. En el ámbito de los datos públicos, esa honestidad no es opcional: es un compromiso ético con la verdad y con la confianza ciudadana.

Accesibilidad: visualizar para todos

Por otro lado, uno de los aspectos frecuentemente olvidado es la accesibilidad. Aproximadamente el 8 % de los hombres y el 0,5 % de las mujeres tienen algún tipo de daltonismo. Herramientas como Color Oracle permiten simular cómo se ven nuestras visualizaciones para personas con diferentes tipos de deficiencias en la percepción del color.

Además, en el webinar se mencionó el proyecto Chartability, una metodología para evaluar la accesibilidad de las visualizaciones de datos. En el sector público español, donde la accesibilidad web es un requisito legal, esto no es opcional: es una obligación democrática. Bajo esta premisa publicó la Federación Española de Municipios y Provincias publicó una Guía de Visualización de Datos para Entidades Locales.

Narrativa visual: cuando los datos cuentan historias

Una vez resueltas las cuestiones técnicas, podemos abordar el aspecto narrativo que cada día es más importante para comunicar correctamente. En este sentido, el curso plantea un método sencillo pero poderoso:

- Escribe una frase larga que resuma los puntos que quieres comunicar.

- Divide esa frase en componentes, aprovechando las pausas naturales.

- Transforma esos componentes en secciones de tu infografía.

Este enfoque narrativo es especialmente efectivo para proyectos como los que encontramos en data.europa.eu, donde se combinan visualizaciones con explicaciones contextuales para comunicar el valor de los conjuntos de datos de alto valor o en los ejercicios de visualización y ciencia de datos de datos de datos.gob.es.

El futuro de la visualización de datos también incluye aproximaciones más creativas y centradas en el usuario. Proyectos que incorporan elementos personalizados, que permiten a los lectores situarse en el centro de la información, o que utilizan técnicas narrativas para generar empatía, están redefiniendo lo que entendemos por "comunicación de datos".

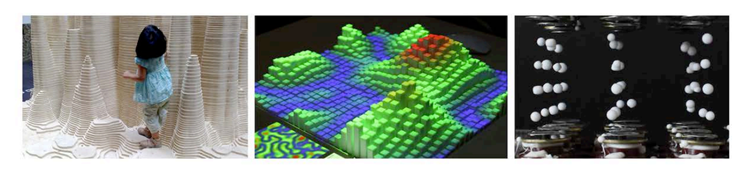

Incluso emergen formas alternativas de "sensificación de datos": la fisicalización (crear objetos tridimensionales con datos) y la sonificación (traducir datos a sonido) abren nuevas posibilidades para hacer la información más tangible y accesible. La empresa española Tangible Data, de la que nos hacemos eco en datos.gob.es porque reutiliza conjuntos de datos abiertos, es prueba de ello.

Figura 1. Ejemplos de sensificación de datos. Fuente: https://data.europa.eu/sites/default/files/course/webinar-data-visualisation-episode-3-slides.pdf

A modo de conclusión, podemos resaltar que la integridad en el diseño no es un lujo: es un requisito ético. Cada gráfico que publicamos en plataformas oficiales influye en cómo los ciudadanos perciben la realidad y toman decisiones. Por eso, dominar herramientas técnicas como las bibliotecas y API de visualización, que se analizan en otros artículos del portal, es tan relevante.

La próxima vez que crees una visualización con datos abiertos, no te preguntes solo "¿qué herramienta uso?" o "¿qué gráfico se ve mejor?". Pregúntate: ¿qué necesita realmente saber mi audiencia? ¿Esta visualización respeta la integridad de los datos? ¿Es accesible para todos? Las respuestas a estas preguntas son las que transforman un gráfico bonito en una herramienta de comunicación verdaderamente efectiva.

La educación tiene el poder de transformar vidas. Reconocida como un derecho fundamental por la comunidad internacional, constituye un pilar clave para el desarrollo humano y social. Sin embargo, según datos de la UNESCO, 272 millones de niños y jóvenes siguen sin acceso a la escuela, el 70% de los países destina menos del 4% de su PIB a la educación y aún son necesarios 69 millones de docentes más para lograr la educación primaria y secundaria universal en 2030. Ante este desafío global, los recursos educativos abiertos y las iniciativas de acceso libre se presentan como herramientas decisivas para fortalecer los sistemas de enseñanza, reducir desigualdades y avanzar hacia una educación inclusiva, equitativa y de calidad.

Los recursos educativos abiertos (REA) ofrecen tres beneficios principales: aprovechan las posibilidades de las tecnologías digitales para solucionar retos educativos comunes; actúan como catalizadores de innovación pedagógica y social al transformar la relación entre docentes, estudiantes y conocimiento; y contribuyen a mejorar el acceso equitativo a materiales educativos de alta calidad.

Qué son los recursos educativos abiertos (REA)

Según la UNESCO, los recursos educativos abiertos son "materiales de aprendizaje, enseñanza e investigación en cualquier formato y soporte que existen en el dominio público o están bajo derechos de autor y fueron liberados bajo una licencia abierta". El concepto, acuñado en el foro celebrado en París en el año 2002, tiene como característica fundamental que estos recursos permiten "su acceso sin coste, su reutilización, reorientación, adaptación y redistribución por parte de terceros".

Los REA abarcan una amplia variedad de formatos, desde cursos completos, libros de texto y programas curriculares hasta mapas, vídeos, pódcasts, aplicaciones multimedia, herramientas de evaluación, aplicaciones móviles, bases de datos e incluso simulaciones.

Los recursos educativos abiertos están constituidos por tres elementos que funcionan de manera inseparable:

- Contenidos educativos: incluyen todo tipo de material utilizable en el proceso de enseñanza-aprendizaje, desde objetos formales hasta recursos externos y sociales. Es aquí donde entrarían los datos abiertos, los cuales se pueden aprovechar para generar este tipo de recursos.

- Herramientas tecnológicas: software que permite desarrollar, utilizar, modificar y distribuir el contenido, incluyendo aplicaciones para la creación de contenidos y plataformas para comunidades de aprendizaje.

- Licencias abiertas: elemento diferenciador que respeta la propiedad intelectual mientras proporciona permisos para el uso, adaptación y redistribución de los materiales.

Por tanto, los REA se caracterizan principalmente por su accesibilidad universal, eliminando barreras económicas y geográficas que tradicionalmente limitan el acceso a la educación de calidad.

Innovación educativa y transformación pedagógica

La transformación pedagógica constituye uno de los principales impactos de los recursos educativos abiertos en el panorama educativo actual. Los REA no son simples contenidos digitales gratuitos, sino catalizadores de innovación que están redefiniendo los procesos de enseñanza-aprendizaje a nivel global.

Combinados con metodologías pedagógicas adecuadas y objetivos de aprendizaje bien diseñados, los REA ofrecen nuevas opciones de enseñanza innovadoras para lograr que tanto los docentes como los estudiantes asuman un papel más activo en el proceso educativo e incluso en la creación de contenidos. Fomentan competencias esenciales como el pensamiento crítico, la autonomía y la capacidad de “aprender a aprender”, superando los modelos tradicionales basados en la memorización.

La innovación educativa impulsada por los REA se materializa a través de herramientas tecnológicas abiertas que facilitan su creación, adaptación y distribución. Programas como eXeLearning permiten desarrollar contenidos educativos digitales de manera sencilla, mientras que LibreOffice e Inkscape ofrecen alternativas libres para la producción de materiales.

La interoperabilidad lograda mediante estándares abiertos, como IMS Global o SCORM, garantiza que estos recursos puedan integrarse en diferentes plataformas y, por tanto, la accesibilidad para todos los usuarios, incluidas personas con discapacidades.

Otra innovación prometedora para el futuro de los REA es la combinación de tecnologías descentralizadas como Nostr con herramientas de autoría como LiaScript. Este enfoque resuelve la dependencia de servidores centrales, permitiendo crear un curso completo y distribuirlo a través de una red abierta y resistente a la censura. El resultado es un único y permanente enlace (URI de Nostr) que encapsula todo el material, otorgando al creador la soberanía total sobre su contenido y garantizando su perdurabilidad. En la práctica, esto supone una revolución para el acceso universal al conocimiento. Los educadores comparten su trabajo con la seguridad de que el enlace será siempre válido, mientras que los estudiantes acceden al material de forma directa, sin necesidad de plataformas o intermediarios. Esta sinergia tecnológica es un paso fundamental para materializar la promesa de un ecosistema educativo verdaderamente abierto, resiliente y global, donde el conocimiento fluye sin barreras.

El potencial de los Recursos Educativos Abiertos se concreta gracias a las comunidades y proyectos que los desarrollan y difunden. Iniciativas institucionales, repositorios colaborativos y programas promovidos por organismos públicos y docentes aseguran que los REA sean accesibles, reutilizables y sostenibles.

Colaboración y comunidades de aprendizaje abiertas

La dimensión colaborativa representa uno de los pilares fundamentales que sostienen el movimiento de recursos educativos abiertos. Este enfoque trasciende fronteras y conecta a profesionales de la educación a nivel global.

Las comunidades educativas alrededor de los REA han generado espacios donde docentes comparten experiencias, acuerdan aspectos metodológicos y resuelven dudas sobre la aplicación práctica de estos recursos. La coordinación entre profesionales suele producirse en redes sociales o a través de canales digitales como Telegram, en los que participan tanto usuarios como creadores de contenidos. Este "claustro virtual" facilita la implementación efectiva de metodologías activas en el aula.

Más allá de los espacios surgidos por iniciativa de los propios docentes, distintos organismos e instituciones han promovido proyectos colaborativos y plataformas que facilitan la creación, el acceso y el intercambio de Recursos Educativos Abiertos, ampliando así su alcance e impacto en la comunidad educativa.

Proyectos y repositorios de REA en España

En el caso de España, los Recursos Educativos Abiertos cuentan con un ecosistema consolidado de iniciativas que reflejan la colaboración entre administraciones públicas, centros educativos, comunidades docentes y entidades culturales. Plataformas como Procomún, proyectos de creación de contenidos como EDIA (Educativo, Digital, Innovador y Abierto) o CREA (Creación de Recursos Educativos Abiertos), y repositorios digitales como Hispana muestran la diversidad de enfoques adoptados para poner a disposición de la ciudadanía recursos educativos y culturales en abierto. A continuación, te contamos un poco más sobre ellos:

- El Proyecto EDIA (Educativo, Digital, Innovador y Abierto), desarrollado por el Centro Nacional de Desarrollo Curricular en Sistemas no Propietarios (CEDEC), se centra en la creación de recursos educativos abiertos diseñados para integrarse en entornos que fomentan las competencias digitales y que se adaptan a metodologías activas. Los recursos se crean con eXeLearning, que facilita la edición, e incluyen plantillas, guías, rúbricas y todos los documentos necesarios para llevar al aula la propuesta didáctica.

- La red Procomún nació fruto del Plan de Cultura Digital en la Escuela puesto en marcha en 2012 por el Ministerio de Educación, Cultura y Deporte. Actualmente este repositorio cuenta con más de 74.000 recursos y 300 itinerarios de aprendizaje, junto a un banco multimedia de 100.000 activos digitales bajo la licencia Creative Commons y que, por tanto, se pueden reutilizar para crear nuevos materiales. Dispone, además, de una aplicación móvil. Procomún también utiliza eXeLearning y el estándar LOM-ES, lo que asegura una descripción homogénea de los recursos y facilita su búsqueda y clasificación. Además, es una web semántica, lo que supone que puede conectarse con comunidades existentes a través de la Linked Open Data Cloud.

Desde las comunidades autónomas también se ha promovido la creación de recursos educativos abiertos. Un ejemplo es CREA, un programa de la Junta de Extremadura orientado a la producción colaborativa de recursos educativos abiertos. Su plataforma permite al profesorado crear, adaptar y compartir materiales didácticos estructurados, integrando contenidos curriculares con metodologías activas. Los recursos se generan en formatos interoperables y se acompañan de metadatos que facilitan su búsqueda, reutilización e integración en distintas plataformas.

Existen iniciativas similares, como el proyecto REA-DUA en Andalucía, que aglutina más de 250 recursos educativos para primaria, secundaria y bachillerato, con atención a la diversidad. Por su parte, Galicia puso en marcha el curso 2022-23 cREAgal cuyo portal cuenta en la actualidad con más de 100 recursos de educación primaria y secundaria. Este proyecto incide en la inclusión y promueve la autonomía personal del alumnado. Además, desde algunas consejerías de educación se ponen a disposición recursos educativos abiertos, como es el caso de Canarias.

Hispana, el portal de acceso al patrimonio cultural español

Además de estas iniciativas orientadas a la creación de recursos educativos, han surgido otras que promueven la recopilación de contenidos que no fueron creados con un fin educativo pero que pueden ser utilizados en el aula. Es el caso de Hispana, un portal de agregación de fondos digitales de bibliotecas, archivos y museos españoles.

Para proporcionar acceso al patrimonio cultural y científico español, Hispana recolecta y hace accesibles los metadatos de los objetos digitales, permitiendo visualizar dichos objetos a través de enlaces que dirigen a las páginas de las instituciones propietarias. Además de actuar como recolector, Hispana también agrega el contenido de las instituciones que lo deseen a Europeana, la biblioteca digital europea, lo que permite aumentar la visibilidad y reutilización de los recursos.

Hispana es un repositorio OAI-PMH, lo que significa que utiliza el protocolo Open Archives Initiative – Protocol for Metadata Harvesting, un estándar internacional para la recolección e intercambio de metadatos entre repositorios digitales. Así, Hispana recolecta los metadatos de los archivos, museos y bibliotecas españoles que exponen sus fondos con este protocolo y los envía a Europeana.

Iniciativas internacionales y cooperación global

A nivel global es importante destacar el papel de la Unesco a través de la Coalición Dinámica sobre los REA, que busca coordinar esfuerzos para aumentar la disponibilidad, calidad y sostenibilidad de estos activos.

En Europa, ENCORE+ (European Network for Catalysing Open Resources in Education) busca fortalecer el ecosistema europeo de REA. Entre sus objetivos se encuentra crear una red que conecte universidades, empresas y organismos públicos para impulsar la adopción, reutilización y calidad de los REA en Europa. ENCORE+ promueve, además, la interoperabilidad entre plataformas, la estandarización de metadatos y la cooperación para garantizar la calidad de los recursos.

En Europa se han desarrollado otras iniciativas interesantes como EPALE (Electronic Platform for Adult Learning in Europe), una iniciativa de la Comisión Europea dirigida a los especialistas en educación para personas adultas. La plataforma contiene estudios, informes y materiales formativos, muchos de ellos bajo licencias abiertas, lo que contribuye a la difusión y uso de los REA.

Además, existen numerosos proyectos que generan y ponen a disposición recursos educativos abiertos en todo el mundo. En Estados Unidos, OER Commons funciona como un repositorio global de materiales educativos de diferentes niveles y materias. Este proyecto utiliza Open Author, un editor en línea que facilita que docentes sin conocimientos técnicos avanzados creen y personalicen recursos educativos digitales directamente en la plataforma.

Otro proyecto destacado es el Plan Ceibal, un programa público en Uruguay que representa un modelo de inclusión tecnológica para la igualdad de oportunidades. Además de proveer acceso a tecnología, genera y distribuye REA en formatos interoperables, compatibles con estándares como SCORM y metadatos estructurados que facilitan su búsqueda, integración en plataformas de aprendizaje y reutilización por parte del profesorado.

Junto a iniciativas como estas, existen otras que, aunque no producen recursos educativos abiertos de manera directa, sí fomentan su creación y uso mediante la colaboración entre docentes y estudiantes de diferentes países. Es el caso de proyectos como eTwinning y Global Classroom.

La fortaleza de los REA radica en su contribución a la democratización del conocimiento, su naturaleza colaborativa y su capacidad para impulsar metodologías innovadoras. Al derribar barreras geográficas, económicas y sociales, los recursos educativos abiertos hacen que el derecho a la educación esté un poco más cerca de convertirse en una realidad universal.

El sector de los datos abiertos es muy activo. Para estar al día de todo lo que ocurre, desde datos.gob.es publicamos una recopilación de novedades como el desarrollo de nuevas aplicaciones tecnológicas, avances legislativos u otras noticias relacionadas.

Hace seis meses, ya hicimos la última recopilación del año 2024. En esta ocasión, vamos a resumir algunas innovaciones, mejoras y logros del primer semestre de 2025.

Marco normativo: nuevas regulaciones que transforman el panorama

Una de las novedades más significativas es la publicación del Reglamento relativo al Espacio Europeo de Datos de Salud por parte del Parlamento Europeo y el Consejo. Esta normativa establece un marco común para el intercambio seguro de datos sanitarios entre los estados miembro, facilitando tanto la investigación médica como la prestación de servicios sanitarios transfronterizos. Además, este hito representa un cambio paradigmático en la gestión de datos sensibles, demostrando que es posible conciliar la privacidad y protección de datos con la necesidad de compartir información para el bien común. Las implicaciones para el sistema sanitario español son considerables, ya que permitirá una mayor interoperabilidad con otros países europeos y facilitará el desarrollo de proyectos de investigación colaborativos.

Por otro lado, la entrada en vigor de la Ley Europea de IA establece normas claras para el desarrollo de esta tecnología, garantizando la seguridad, transparencia y respeto de los derechos humanos. Este tipo de normativas son especialmente relevantes en el contexto de datos abiertos, donde la transparencia algorítmica y la explicabilidad de los modelos de IA se convierten en requisitos esenciales.

En España, el compromiso con la transparencia se materializa en iniciativas como el nuevo Observatorio de Derechos Digitales, que cuenta con la participación de más de 150 entidades y 360 personas expertas. Esta plataforma se configura como un espacio de diálogo y seguimiento de las políticas digitales, contribuyendo a garantizar que la transformación digital respete los derechos fundamentales.

Innovaciones tecnológicas en España y el extranjero

Uno de los hitos más destacados en el ámbito tecnológico es el lanzamiento de ALIA, la infraestructura pública de recursos de inteligencia artificial. Esta iniciativa busca desarrollar modelos de lenguaje abiertos y transparentes que fomenten el uso del castellano y las lenguas cooficiales españolas en el ámbito de la IA.

ALIA no es solo una respuesta a la hegemonía de los modelos anglosajones, sino una apuesta estratégica por la soberanía tecnológica y la diversidad lingüística. Los primeros modelos ya disponibles han sido entrenados en español, catalán, gallego, valenciano y euskera, marcando un precedente importante en el desarrollo de tecnologías inclusivas y culturalmente sensibles.

Con relación a esta innovación, las aplicaciones prácticas de la inteligencia artificial se están multiplicando en diversos sectores. Por ejemplo, en el ámbito financiero, la Agencia Tributaria ha adoptado un compromiso ético en el diseño y uso de la inteligencia artificial. En este marco, la comunidad ha desarrollado incluso un chatbot virtual entrenado con datos propios que ofrece orientación legal en temas fiscales y tributarios.

En el sector sanitario, un grupo de radiólogos españoles está trabajando en un proyecto para la detección precoz de lesiones oncológicas utilizando IA, demostrando cómo la combinación de datos abiertos y algoritmos avanzados puede tener un impacto directo en la salud pública.

También combinando IA con datos abiertos se han desarrollado proyectos relacionados con la sostenibilidad medioambiental. Este modelo desarrollado en España combina IA y datos meteorológicos abiertos para predecir la producción de energía solar en los próximos 30 años, proporcionando información crucial para la planificación energética nacional.

Otro sector relevante en lo que respecta a la innovación tecnológica es el de las smart cities. En estos últimos meses, Las Palmas de Gran Canaria ha digitalizado sus mercados municipales combinando redes WiFi, dispositivos IoT, un gemelo digital y plataformas de datos abiertos. Esta iniciativa integral busca mejorar la experiencia del usuario y optimizar la gestión comercial, demostrando cómo la convergencia tecnológica puede transformar espacios urbanos tradicionales.

Zaragoza, por su parte, ha desarrollado un mapa de vulnerabilidad utilizando inteligencia artificial aplicada a datos abiertos, proporcionando una herramienta valiosa para la planificación urbana y las políticas sociales.

Otro caso relevante es el proyecto de la Iniciativa Open Data Barcelona, #iCuida, que destaca como un ejemplo innovador de reutilización de datos abiertos para mejorar la vida de las cuidadoras y trabajadoras del hogar. Esta aplicación demuestra cómo los datos abiertos pueden dirigirse a colectivos específicos y generar impacto social directo.

Por último, pero no menos importante, a nivel global, este semestre DeepSeek ha lanzado DeepSeek-R1, una nueva familia de modelos generativos especializados en razonamiento, publicando tanto los modelos como su metodología de entrenamiento completa en código abierto, contribuyendo al avance democrático de la IA.

Nuevos portales de datos abiertos y herramientas de mejora

En toda esta vorágine de innovación y tecnología, el panorama de los portales de datos abiertos se ha enriquecido con nuevas iniciativas sectoriales. El Colegio de Registradores Mercantiles y de la Propiedad de España ha presentado su plataforma de datos abiertos, permitiendo acceso inmediato a datos registrales sin esperar informes periódicos. Esta iniciativa representa un cambio significativo en la transparencia del sector registral.

En el ámbito sanitario, el portal 'I+Salud' del sistema sanitario público de Andalucía recoge y difunde desde un sitio único los recursos y datos sobre actividades y resultados de investigación, facilitando el acceso a información científica relevante.

Además de la disponibilidad de datos, hay un tratamiento que los hace más accesibles al público general: la visualización de datos. La Universidad de Granada ha desarrollado 'UGR en cifras', un espacio de acceso libre con sección de datos abiertos que facilita la exploración de estadísticas oficiales y se erige como pieza fundamental en la transparencia universitaria.

Por otro lado, IDENA, la nueva herramienta del Geoportal de Navarra, incorpora funcionalidades avanzadas para buscar, navegar, incorporar mapas, compartir datos y descargar información geográfica, siendo operativa en cualquier dispositivo.

Formación para el futuro: eventos y jornadas

El ecosistema formativo en este ecosistema se fortalece cada año con eventos como la Cumbre de Gestión del Dato (Data Management Summit) en Tenerife, que aborda la interoperabilidad en administraciones públicas y la inteligencia artificial. Otro evento de referencia en los datos abiertos que también se celebró en Canarias fue el Encuentro Nacional de Datos Abiertos.

Más allá de estos eventos, la innovación colaborativa también ha fomentado a través de hackathones especializados, como el dedicado a soluciones de IA generativa para la biodiversidad o el Merkle Datathon en Gijón. Estos eventos no solo generan soluciones innovadoras, sino que también crean comunidades de práctica y fomentan el talento emergente.

Un año más, los concursos de datos abiertos de Castilla y León y Euskadi han premiado proyectos que demuestran el potencial transformador de la reutilización de datos abiertos, inspirando nuevas iniciativas y aplicaciones.

Perspectiva internacional y tendencias globales: la cuarta ola de datos abiertos

Open Data Policy Lab habló en los EU Open Data Days de lo que se conoce como la "cuarta ola" de datos abiertos, estrechamente vinculada a la IA generativa. Esta evolución representa un salto cualitativo en la forma de procesar, analizar y utilizar los datos públicos, donde los modelos de lenguaje natural permiten interacciones más intuitivas y análisis más sofisticados.

En general, el panorama de datos abiertos en 2025 revela una transformación profunda del ecosistema, donde la convergencia entre inteligencia artificial, marcos normativos avanzados y aplicaciones especializadas está redefiniendo las posibilidades de la transparencia y la innovación pública.

La inteligencia artificial ya no es cosa del futuro: está aquí y puede convertirse en una aliada en nuestro día a día. Desde facilitarnos tareas en el trabajo, como redactar correos o resumir documentos, hasta ayudarnos a organizar un viaje, aprender un nuevo idioma o planificar nuestros menús semanales, la IA se adapta a nuestras rutinas para hacernos la vida más fácil. No hace falta ser un experto en tecnología para sacarle partido; si bien las herramientas actuales son muy accesibles, comprender sus capacidades y saber cómo formular las preguntas adecuadas maximizará su utilidad.

Sujetos pasivos y activos de la IA

Las aplicaciones de la inteligencia artificial en el día a día están transformando nuestra vida cotidiana. La IA abarca ya múltiples campos de nuestras rutinas. Los asistentes virtuales, como Siri o Alexa, se encuentran entre las herramientas más conocidas que incorporan inteligencia artificial, y se utilizan para responder preguntas, programar citas o controlar dispositivos.

Muchas personas usan a diario herramientas o aplicaciones con inteligencia artificial, aunque esta opere de forma imperceptible para al usuario y no requiera su intervención. Google Maps, por ejemplo, utiliza IA para optimizar rutas en tiempo real, predecir el estado del tráfico, sugerir caminos alternativos o estimar la hora de llegada. Spotify la aplica para personalizar las listas de reproducción o sugerir canciones, y Netflix para realizar recomendaciones y adaptar el contenido que se muestra a cada usuario.

Pero también es posible ser un usuario activo de la inteligencia artificial utilizando herramientas que interactúan directamente con los modelos. Así, podemos hacer preguntas, generar textos, resumir documentos o planificar tareas. La IA deja de ser un mecanismo oculto para convertirse en una especie de copiloto digital que nos asiste en nuestro día a día. ChatGPT, Copilot o Gemini son herramientas que nos permiten usar la IA sin necesidad de ser expertos. Esto nos facilita la automatización de tareas cotidianas, liberando tiempo para dedicarlo a otras actividades.

IA en el hogar y la vida personal

Los asistentes virtuales responden a comandos de voz y nos informan de qué hora es, el tiempo que va a hacer o nos ponen la música que queremos escuchar. Pero sus posibilidades van mucho más allá, ya que son capaces de aprender de nuestros hábitos para anticiparse a nuestras necesidades. Pueden controlar diferentes dispositivos que tenemos en el hogar de manera centralizada, como la calefacción, el aire acondicionado, las luces o los dispositivos de seguridad. También es posible configurar acciones personalizadas que se activen a través de un comando de voz. Por ejemplo, una rutina “buenos días” que encienda las luces, nos informe del pronóstico del tiempo y del estado del tráfico.

Cuando hemos perdido el manual de alguno de los electrodomésticos o aparatos electrónicos que tenemos en casa, la inteligencia artificial es una buena aliada. Enviando una foto del dispositivo, nos ayudará a interpretar las instrucciones, configurarlo o solucionar problemas básicos.

Si quieres ir más allá, la IA puede hacer por ti algunas tareas de la vida cotidiana. A través de estas herramientas podemos planificar nuestros menús semanales, indicando necesidades o preferencias, como platos aptos para celiacos o vegetarianos, preparar la lista de la compra y obtener las recetas. También nos puede ayudar a elegir entre los platos de la carta de un restaurante teniendo en cuenta nuestras preferencias y restricciones alimentarias, como alergias o intolerancias. A través de una simple foto de la carta, la IA nos ofrecerá sugerencias personalizadas.

El ejercicio físico es otro ámbito de nuestra vida personal en el que estos copilotos digitales son muy valiosos. Podemos pedirle, por ejemplo, que cree rutinas de ejercicios adaptadas a diferentes condiciones físicas, objetivos y material disponible.

La planificación de unas vacaciones es otra de las funcionalidades más interesantes de estos asistentes digitales. Si les proporcionamos un destino, un número de días, intereses e incluso presupuesto, tendremos un plan completo para nuestro próximo viaje.

Aplicaciones de la IA en los estudios

La IA está transformando profundamente la forma de estudiar, ofreciendo herramientas que personalizan el aprendizaje. Ayudar a los más pequeños de la casa en sus tareas escolares, aprender un idioma o adquirir nuevas habilidades para nuestro desarrollo profesional son solo algunas de las posibilidades.

Existen plataformas que generan contenidos personalizados en apenas unos minutos y material didáctico realizado a partir de datos abiertos que se puede utilizar tanto en el aula como en casa para repasar. Entre los universitarios o los estudiantes de secundaria y bachillerato, algunas de las opciones más populares son las aplicaciones que resumen o hacen esquemas a partir de textos más largos. Incluso es posible generar un pódcast desde un fichero, lo que nos puede ayudar a entender y familiarizarnos con un tema mientras hacemos deporte o cocinamos.

Pero también podemos crear nuestras aplicaciones para estudiar o incluso simular exámenes. Sin tener conocimientos de programación, es posible generar una aplicación para aprender las tablas de multiplicar, los verbos irregulares en inglés o lo que se nos ocurra.

Cómo usar la IA en el trabajo y las finanzas personales

En el ámbito profesional la inteligencia artificial ofrece herramientas que aumentan la productividad. De hecho, se estima que en España un 78% de los trabajadores utilizan ya herramientas de IA en el ámbito laboral. Al automatizar procesos, ahorramos tiempo para centrarnos en tareas de más valor. Estos asistentes digitales resumen documentos largos, generan informes especializados en un campo, redactan correos electrónicos o toman notas en las reuniones.

Algunas plataformas incorporan ya la transcripción de las reuniones en tiempo real, algo que puede resultar muy útil si no dominamos el idioma. Microsoft Teams, por ejemplo, ofrece a través de Copilot opciones útiles desde la pestaña “Resumen” de la propia reunión, como la transcripción, un resumen o la posibilidad de agregar notas.

El manejo de las finanzas personales ha evolucionado igualmente gracias a aplicaciones que utilizan IA, permitiendo controlar gastos y gestionar un presupuesto. Pero también podemos crear nuestro propio asesor financiero personal utilizando alguna herramienta de IA, como ChatGPT. Al proporcionarle información sobre ingresos, gastos fijos, variables y objetivos de ahorro, analiza los datos y crea planes financieros personalizados.

Prompts y creación de aplicaciones útiles para el día a día

Hemos visto las grandes posibilidades que nos brinda la inteligencia artificial como copiloto en nuestro día a día. Pero para lograr que sea un buen asistente digital, debemos saber cómo preguntarle y darle las instrucciones precisas.